和IOS6聊聊天

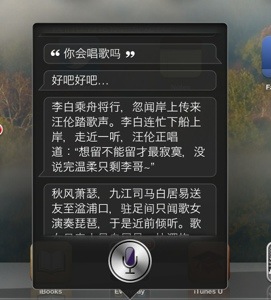

首先,不要误会。我还没有空虚到那种程度,像生活大爆炸的 Rajesh 一样需要和 Siri 聊天来解闷。不过,新发布的 IOS 6 的语音输入,特别是支持了中文交互的 Siri,确实是很让人很惊喜的功能。

根据我目前的测试,Siri 发送信息到 Facebook,Twitter,短信,电子邮件,都没有问题。向新浪微博的发布功能有待加强。当然,目前这些功能需要以依赖网络来实现。这也许正是这个功能强大的基础——云端的语音处理。

于是,今天在上夜班的路上,我就一边走一边和手机聊天,写下了这些文字,来简单介绍一下我对语音输入的看法。这篇文字是我完全在手机上用语音输入的。当然输入之后,人共进行了错误的修改(包括所有的半角逗号转化为全角,以及在英文两侧添加空格)。

回到刚才走的路上,我一边走,一边在和手机说话。当然,这里所说的说话,并不是和 Siri 进行交互,我在用听写功能在随便记笔记。经过一路的使用,我发现:其实这个语音识别,对大段的文字的效率不是很好,比较适合两三句(以逗号为单位)为单位进行记录。除了语音识别的输入长度有限制之外(时间限制),另外的原因,可能是、我正在路上周围的噪音还是比较严重。好在路上没有什么行人,主要是汽车驶过的声音。

语音输入,对于懒人是个福音。由于 iPhone 的键盘被很多人诟病,这个结论仍然成立。另外的原因是出于安全,特别是在交通比较繁忙的路上,由于不必一直看着屏幕,用语音输入可以提高安全性。不用担心,一边走一边用手敲键盘,被车撞倒(相比国内,海外的车开得飞快)。

也许有人认为,在现在跨平台的写作软件很多,写作不一定非要在手机上。平时很多时候都在电脑上完成。自然,在一个大屏幕上面输入,舒适度是更好的。但是有以下几个问题。

第一个问题是,一些工作,还是需要在空闲时间来做,比如下班路上,下午茶的时间,吃饭前后,等等。而一些琐碎的工作,利用空闲的时间来完成,是很有效地利用零散时间的方法,比如发微博,写日记,等等。

另外一个问题就是,很多时候,灵感出现是随时随地的。比如,我在办公室的时候,思路常常集中在电脑上要处理的工作。灵光一现的时候,常常是发生在吃饭的时候,散步时候,在公交车上,等等。而这些时候,常常是手持设备发挥作用的重要时候。而传统的手持设备,不是一个快速输入工具(比如 iPhone 令人诟病的键盘)。相比较电脑键盘,我认为手机键盘完全不是一个有效的输入工具(只用拇指或食指输入,实在可笑)。相比较而言,有效的语音输入会是非常优雅、快速、而准确的输入工具(个人认为,OSX 系统的语音输入,已经超过了其内置的中文输入法)。当然,这也取决于开发商是否开发了一个有效的工具,它的准确率如何。

在大学的时候,我曾经使用过微软中国研究院开发的语音输入法。这种体验,简直可以用痛苦来形容。这次苹果显然交上了一个让人满意的答卷。

我对语音输入,主要有以下几点要求:第一,要有足够的连贯性,也就是用户不用考虑软件的输入速度完全可以依靠自己的思路直接进行叙述,类似于演讲的过程(自然,连珠炮似的语速是不现实的)。第二,用户可以依照自己的习惯使用,而不需要对软件来进行过多的适应(当年使用的微软中文语音输入法,其中一个重要的步骤,就是要先朗读一段文字,对你的语音来进行采样,让机器来学习你的使用习惯。我记得很清楚,一段文字是李开复的一段演讲。现在想想,这个设置实在有点洗脑的嫌疑)。其中包含的个人因素包括语速,发音,停顿,标点,等等。第三条,当然也是最重要的,就是准确度要高,对上下文的识别能力要比较强。第四,有足够的定制功能。一些特殊字符,比如“ @ ”,中文英文混排可以识别的;或者用户可以自行设置的。方便一些特殊领域的人员语音输入。而不只是象我,仅仅在这里写写日记。

回到发微博这件事儿,我发现语音确实不是一个发 twitter 的好方法。因为很多时候, twitter 涉及到和网友进行交互,而 Siri 是不能完成这些工作的,很简单的“ @ ”这个功能都不能实现。只适合写感受这种纯文字的推,不能添加图片,链接,视频,等等。当然,也可以通过语音来输入文字,其他的附加功能,通过键盘来实现。但通过语音来实现大部分的完整的功能,是显而易见的发展方向。

如果只是写文章,我在路上写下这篇日记——感觉很舒服。形象地说,就是一边走,一边说,说到一段完成,就停下来看看输入是否正确。总体上来说,听写的功能的准确率较高。记得以前曾经有人说过,写作是最重要的就是,让自己写字的速度能跟上自己思考的速度。我认为,通过键盘来进行打字,并不是一个高效率的输入方法。除了输入速度的问题,还要经常考虑到错别字的修正,调整格式,等等(当然,这与个人习惯有关)。写作的思路经常会被一些因素干扰,而不能集中精神进行思考。而听写完全克服了这些问题,其实这个和用录音笔来进行记录非常相似。也类似于演讲(当然,你可以通过这个功能来锻炼自己演讲的能力,即口语和书面语的统一)。听写功能是否会成为作家主要的写作方式呢,我相信她会有很好的前景。

其实之前在路上走,尤其是上下班的路上,常常无所事事。有时候我会听歌。而更多的时候,耳朵里没有塞的什么东西的时候,我在神游,但这些思考的问题并不能及时的转化成文字记录下来。这是用录音笔进行记录,是一个很好的方法。但语音的问题在于,你需要回去之后,再听一遍,整理成文字,而浪费一定时间。有效的语音识别软件可以节省这人工录入的过程。

听写功能还是需要联网实现。可以看出这是一个云计算的服务。和传统的单机的语音识别软件不同(比如说微软开发的语音识别方法)。之前苹果有开发过类似的语音控制程序,例如 Chess,现在依然保留在山狮系统中(升级了新系统的朋友可以去电脑上体验一下)。这些程序,都不是依靠云端强大的服务器进行语音识别,它们功能有限的,精确度受机器硬件的影响,自我学习能力也不强(显然,对用户采样量有限)。因此用户的体验不光滑。在这个用户体验为王的时代,平滑度很重要。至少目前我对听写的平滑度很满意。

想象一下,一边散步,一边去写这么一段的文字,确实是有趣的体验。

此外另外一个重要的方面,就是同时思考和组织语言,有利于提高学习效率和培养思维习惯。同时也锻炼演讲的能力。这些对于学生来说实用的技能,恰恰可以通过听写来进行练习。

我最近也在听一些 Podcast ,发现牛人们出口成章的本领令人羡慕的。我也相信,他们并没有用很多的时间去准备稿子。很多时候,制作一个小时长度的 Podcast ,是一个完全凭兴趣的活动,也不盈利,投资成本应该和我一路自言自语差不多吧。从练习演讲的角度,录制 Podcast 和用听功能写文章,其实是殊途同归的。

也许以后,我会用英语听写,也会是练口语的好方式吧。

写了这么多,我发现自己一直在用意识流的方式在喃喃自语。那么,今天先写到这里吧。

发现的问题:

标点符号还是英文的半角而不是中文的全角。这个何在不同的说法下语音输入的语言自动变化的功能不太符合显然是苹果忽略了这个细节。也许在未来的语音输入设置中,可以手工设置输入标点符号的全角和我半角。

对专业词汇的输入需要加强。比如上文的全角和半角,有一处识别错误了,另外一处识别正确了,课间对上下文的理解能力还有待加强。在后期的手工校对还是需要一定工作量。不过,这个功能可以通过在口述的时候增加一些逗号来进行改进;或者等待苹果的服务器自己进行学习。

说了这么多,我觉得有 IOS 的朋友可以赶紧去试一试了,相信你会惊喜。